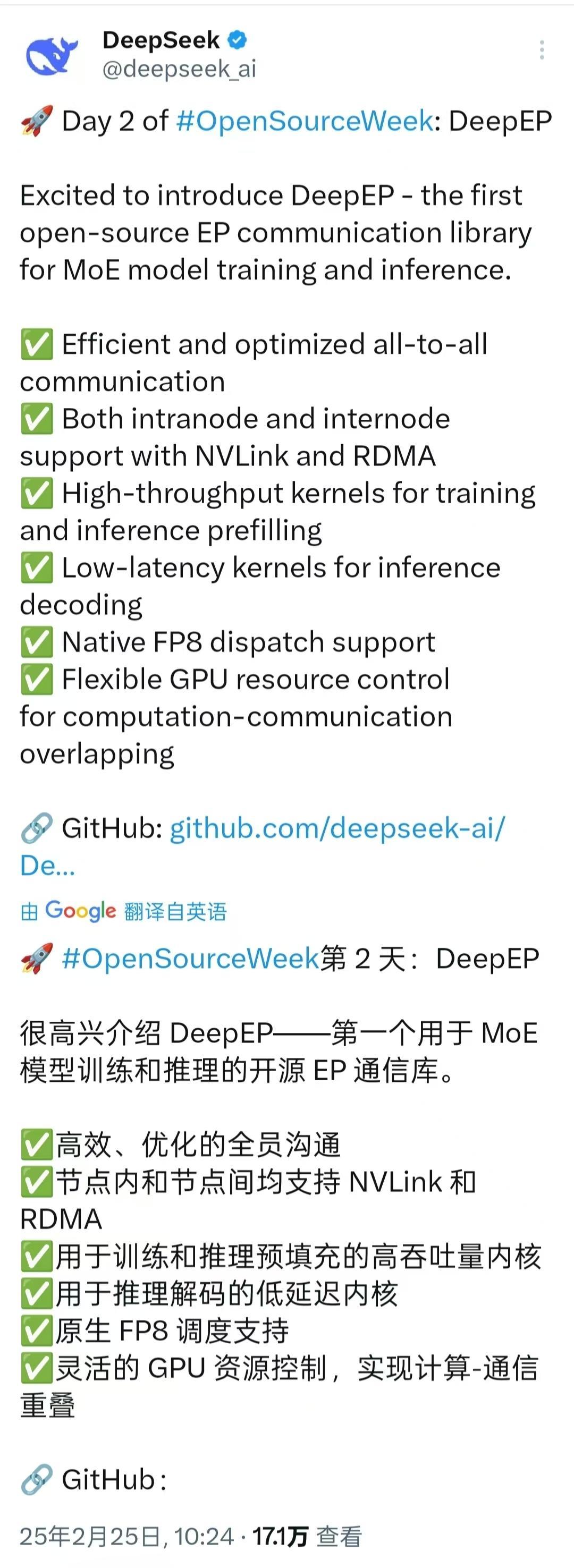

2月25日,DeepSeek在“开源周”的第二日开源了DeepEP通信库,这是第一个用于MoE模型训练和推理的开源EP通信库。

EP即expert parallelism(专家并行),是一种在大规模分布式AI模型训练中使用的技术,能用于提升模型并行处理能力和训练效率。

“高效、优化的全员沟通;节点内和节点间均支持NVLink和RDMA;用于训练和推理预填充的高吞吐量内核;用于推理解码的低延迟内核;原生FP8调度支持;灵活的GPU资源控制,实现计算与通信重叠。”DeepSeek如此介绍DeepEP的特点。

一些网友则在DeepSeek宣布开源的帖子下评论:DeepEP是面向AI团队的全新通信系统。它可以帮助AI“专家”协同工作,即使分布在不同的计算机芯片上也能高效交流。它就像一款超快的消息应用程序,适用于AI组件。使DeepSeek等大规模AI模型能够在多个GPU上流畅运行!(仅适用于Hopper GPU,如H100/80O)。也有人表示,开源EP通信库DeepEP的引入可能会彻底改变AI和区块链应用程序的互操作性。通过改善分散系统之间的通信,它促进更高效的数据交换和处理。这可以降低成本并提高人工智能任务的性能,从而吸引更多开发人员进入加密领域。

记者就开源DeepEP通信库的影响询问DeepSeek,它的回答是,开源DeepEP通信库的影响远超技术本身,其本质是通过开放协作重构技术价值链——从“封闭竞争”转向“共享共建”。长期看,它可能孕育出新的产业生态,甚至重塑全球通信技术格局。然而,其成功依赖于社区的活跃度、商业模式的清晰度及风险管控能力,三者缺一不可。

文、图/广州日报新花城记者:张露

广州日报新花城编辑:麦晓颖